Ο νόμος ψηφίστηκε με 523 ψήφους υπέρ, 46 κατά και 49 αποχές.

Η πράξη, η οποία χρειαζόταν τελική έγκριση μετά την έγκριση σε πολιτικό και τεχνικό επίπεδο, θα τεθεί σε ισχύ πλέον πιθανότατα τον Μάιο.

Ο συνεπικεφαλής του νόμου περί τεχνητής νοημοσύνης του Κοινοβουλίου, ο Ιταλός βουλευτής Μπράντο Μπενιφέι (S&D), την περιέγραψε ως «ιστορική ημέρα» σε συνέντευξη Τύπου που ακολούθησε.

«Έχουμε τον πρώτο κανονισμό στον κόσμο που βάζει έναν ξεκάθαρο δρόμο για μια ασφαλή και ανθρωποκεντρική ανάπτυξη της τεχνητής νοημοσύνης. Έχουμε τώρα ένα κείμενο που αντικατοπτρίζει τις προτεραιότητες του κοινοβουλίου», είπε.

«Το κύριο σημείο τώρα θα είναι η εφαρμογή και η συμμόρφωση των επιχειρήσεων και των ιδρυμάτων. Εργαζόμαστε επίσης για περαιτέρω νομοθεσία για την επόμενη εντολή, όπως μια οδηγία για τις συνθήκες στο χώρο εργασίας και την τεχνητή νοημοσύνη», είπε ο Benifei.

Ο ομόλογός του Dragoş Tudorache (Ρουμανία/Ανανέωση), είπε στην ίδια διάσκεψη ότι η ΕΕ εξετάζει τις χώρες εταίρους για να διασφαλίσει τον παγκόσμιο αντίκτυπο των κανόνων. «Πρέπει να είμαστε ανοιχτοί να συνεργαστούμε με άλλους για το πώς να προωθήσουμε αυτούς τους κανόνες και να οικοδομήσουμε μια διακυβέρνηση με κόμματα που έχουν τον ίδιο τρόπο σκέψης», είπε.

Εναρξη ισχύος

Σύμφωνα με τον νόμο AI, τα συστήματα μηχανικής μάθησης θα χωριστούν σε τέσσερις κύριες κατηγορίες ανάλογα με τον πιθανό κίνδυνο που ενέχουν για την κοινωνία. Τα συστήματα που θεωρούνται υψηλού κινδύνου θα υπόκεινται σε αυστηρούς κανόνες που θα ισχύουν πριν εισέλθουν στην αγορά της ΕΕ.

Οι κανόνες τεχνητής νοημοσύνης γενικής χρήσης θα εφαρμοστούν ένα χρόνο μετά την έναρξη ισχύος, δηλαδή τον Μάιο του 2025, και οι υποχρεώσεις για συστήματα υψηλού κινδύνου σε τρία χρόνια. Θα βρίσκονται υπό την επίβλεψη των εθνικών αρχών, με την υποστήριξη του γραφείου τεχνητής νοημοσύνης εντός της Ευρωπαϊκής Επιτροπής. Θα εναπόκειται πλέον στα κράτη μέλη να δημιουργήσουν εθνικές υπηρεσίες εποπτείας. Η επιτροπή είπε στο Euronews ότι οι χώρες έχουν 12 μήνες για να ορίσουν αυτούς τους επιτηρητές.

Σε απάντηση στη σημερινή ψηφοφορία, η Cecilia Bonefeld-Dahl, επικεφαλής του εμπορικού οργανισμού της ΕΕ Digital Europe, είπε ότι πρέπει να γίνουν περισσότερα για να διατηρηθούν οι εταιρείες με έδρα στην Ευρώπη.

«Σήμερα, μόνο το 3% των παγκόσμιων unicorn εταιριών τεχνητής νοημοσύνης προέρχονται από την ΕΕ, με περίπου 14 φορές περισσότερες ιδιωτικές επενδύσεις στην τεχνητή νοημοσύνη στις ΗΠΑ και πέντε φορές περισσότερες στην Κίνα. Μέχρι το 2030, η παγκόσμια αγορά τεχνητής νοημοσύνης αναμένεται να φτάσει τα 1,5 τρισεκατομμύρια δολάρια και πρέπει να διασφαλίσουμε ότι οι ευρωπαϊκές εταιρείες θα το αξιοποιήσουν χωρίς να μπλέκονται στη γραφειοκρατία», δήλωσε η Bonefeld-Dahl .

Η Ursula Pachl, Αναπληρώτρια Γενική Διευθύντρια της Ευρωπαϊκής Οργάνωσης Καταναλωτών (BEUC), χαιρέτισε την έγκριση του νόμου και είπε ότι θα βοηθήσει τους καταναλωτές να συμμετάσχουν σε συλλογικές αξιώσεις επανόρθωσης εάν έχουν πληγεί από το ίδιο σύστημα τεχνητής νοημοσύνης.

«Αν και η νομοθεσία θα έπρεπε να έχει προχωρήσει περισσότερο για την προστασία των καταναλωτών, η κορυφαία προτεραιότητα για την Ευρωπαϊκή Επιτροπή και τις εθνικές κυβερνήσεις θα πρέπει τώρα να είναι να δείξουν ότι είναι σοβαροί σχετικά με τον νόμο AI, εφαρμόζοντάς τον χωρίς καθυστέρηση και παρέχοντας στις σχετικές ρυθμιστικές αρχές που θα τον επιβάλουν απαραίτητους πόρους», είπε η Pachl.

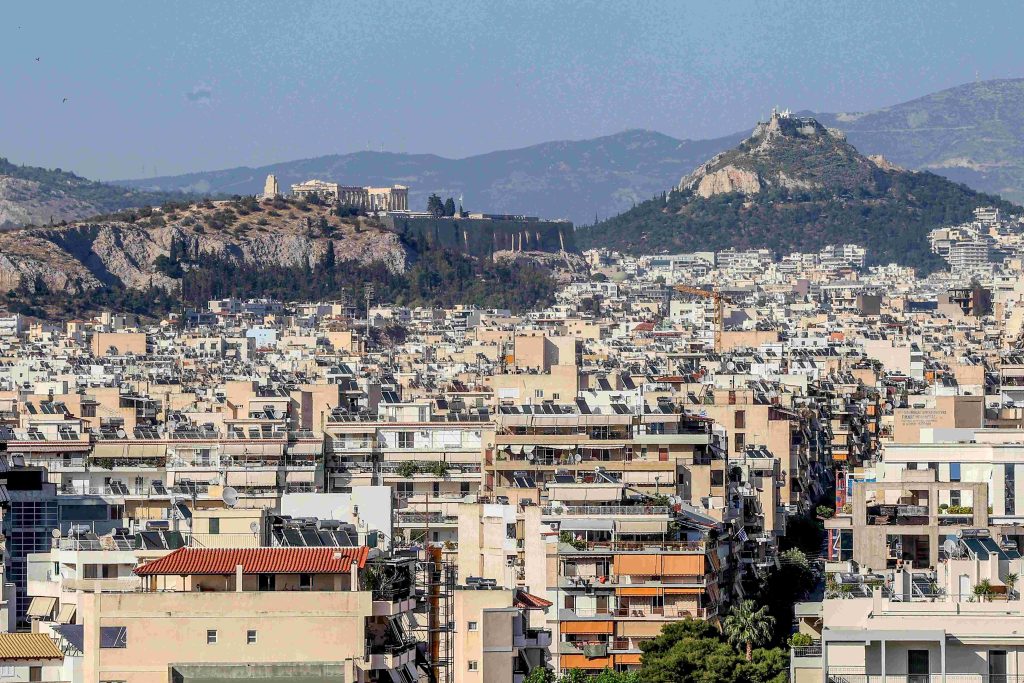

photo: pixabay

Ειδικότερα όπως μεταδίδει το ΑΠΕ-ΜΠΕ:

Καθολική απαγόρευση ορισμένων πρακτικών

Οι νέοι κανόνες απαγορεύουν τις εφαρμογές της τεχνητής νοημοσύνης που απειλούν τα δικαιώματα των πολιτών, όπως είναι τα συστήματα βιομετρικής κατηγοριοποίησης που βασίζονται σε ευαίσθητα χαρακτηριστικά και η μη στοχοθετημένη συλλογή εικόνων προσώπων από το διαδίκτυο ή από κάμερες κλειστού κυκλώματος παρακολούθησης, με στόχο τη δημιουργία βάσεων δεδομένων για την αναγνώριση προσώπων. Θα απαγορεύονται επίσης η αναγνώριση συναισθημάτων στον χώρο εργασίας και το σχολείο, η κοινωνική βαθμολόγηση, η προληπτική αστυνόμευση (όταν βασίζεται αποκλειστικά στην κατάρτιση προφίλ ενός ατόμου ή στην αξιολόγηση των χαρακτηριστικών του) και η τεχνητή νοημοσύνη που χειραγωγεί την ανθρώπινη συμπεριφορά ή εκμεταλλεύεται τα τρωτά σημεία των ανθρώπων.

Εξαιρέσεις για τις αρχές επιβολής του νόμου

Η χρήση συστημάτων βιομετρικής ταυτοποίησης από τις αρχές επιβολής του νόμου απαγορεύεται κατά κανόνα, με εξαίρεση τις συγκεκριμένες περιπτώσεις που παραθέτει και ορίζει λεπτομερώς ο νέος κανονισμός. Η χρήση συστημάτων βιομετρικής ταυτοποίησης «σε πραγματικό χρόνο» επιτρέπεται μόνο υπό αυστηρές προϋποθέσεις: αν, για παράδειγμα, η βιομετρική ταυτοποίηση θα χρησιμοποιηθεί μόνο για περιορισμένο χρόνο και σε περιορισμένη γεωγραφική έκταση, με προηγούμενη ειδική άδεια από τις δικαστικές ή τις διοικητικές αρχές. Τέτοιες περιπτώσεις μπορεί να είναι η στοχευμένη αναζήτηση αγνοουμένου προσώπου ή η πρόληψη μιας τρομοκρατικής επίθεσης. Η χρήση συστημάτων βιομετρικής ταυτοποίησης «σε ύστερο χρόνο» θεωρείται υψηλού κινδύνου και απαιτεί δικαστική έγκριση που θα συνδέεται με κάποιο ποινικό αδίκημα.

Υποχρεώσεις για τα συστήματα υψηλού κινδύνου

Ο νέος κανονισμός θέτει σαφείς υποχρεώσεις και για τα υπόλοιπα συστήματα τεχνητής νοημοσύνης που θεωρούνται υψηλού κινδύνου, λόγω των σημαντικών επιβλαβών επιπτώσεων που ενδέχεται να έχουν στην υγεία, την ασφάλεια, τα θεμελιώδη δικαιώματα, το περιβάλλον, τη δημοκρατία και το κράτος δικαίου. Το κείμενο απαριθμεί τους τομείς στους οποίους χρησιμοποιούνται ή ενδέχεται να χρησιμοποιηθούν τέτοια συστήματα και οι οποίοι είναι: οι κρίσιμες υποδομές, η εκπαίδευση και η επαγγελματική κατάρτιση, η απασχόληση, βασικές ιδιωτικές και δημόσιες υπηρεσίες (π.χ. υγειονομική περίθαλψη, τράπεζες), η επιβολή του νόμου, η διαχείριση της μετανάστευσης και των συνόρων, καθώς και οι δικαστικές και δημοκρατικές διαδικασίες (π.χ. για τον επηρεασμό εκλογικών διαδικασιών). Τα συστήματα αυτά πρέπει να αξιολογούν και να ελαχιστοποιούν τους κινδύνους, να τηρούν αρχεία καταγραφής της χρήσης τους, να είναι διαφανή και ακριβή και να εποπτεύονται από ανθρώπους. Οι πολίτες θα έχουν το δικαίωμα να υποβάλλουν καταγγελίες για τα συστήματα τεχνητής νοημοσύνης και να λαμβάνουν εξηγήσεις για τυχόν αποφάσεις που βασίστηκαν σε συστήματα υψηλού κινδύνου και επηρεάζουν τα δικαιώματά τους.

Απαιτήσεις για διαφάνεια

Τα συστήματα τεχνητής νοημοσύνης «γενικής χρήσης» και τα μοντέλα στα οποία βασίζονται πρέπει να πληρούν ορισμένες απαιτήσεις διαφάνειας, συμπεριλαμβανομένης της συμμόρφωσής τους με τη νομοθεσία της ΕΕ για τα δικαιώματα πνευματικής ιδιοκτησίας και της δημοσιοποίησης λεπτομερών περιλήψεων του περιεχομένου που χρησιμοποιούν για την εκπαίδευση των μοντέλων τους. Για τα ισχυρότερα μοντέλα, που μπορούν να δημιουργήσουν συστημικούς κινδύνους, θα ισχύουν επιπλέον απαιτήσεις, όπως η αξιολόγησή τους, η εκτίμηση και ο περιορισμός των συστημικών κινδύνων και η υποβολή εκθέσεων σχετικά με περιστατικά και δυσλειτουργίες.

Επιπλέον, αν οποιοδήποτε οπτικοακουστικό υλικό είναι τεχνητό ή παραποιημένο (τα λεγόμενα «προϊόντα βαθυπαραποίησης» ή «deepfakes») θα πρέπει να επισημαίνεται σαφώς.

Μέτρα για στήριξη της καινοτομίας και των μικρών και μεσαίων επιχειρήσεων

Οι εθνικές αρχές κάθε χώρας θα πρέπει να δημιουργήσουν «ρυθμιστικά δοκιμαστήρια» για να δοκιμάζονται σε πραγματικές συνθήκες τα συστήματα τεχνητής νοημοσύνης. Οι δομές αυτές θα πρέπει να είναι προσβάσιμες στις μικρές και μεσαίες επιχειρήσεις, καθώς και στις νεοφυείς επιχειρήσεις, για να μπορούν να αναπτύσσουν και να εκπαιδεύουν καινοτόμα μοντέλα τεχνητής νοημοσύνης πριν από τη διάθεσή τους στην αγορά.

(με πληροφορίες από euronews. com – ΑΠΕ-ΜΠΕ / photo: pixabay)