Η τεχνητή νοημοσύνη εξελίσσεται με ρυθμό που είναι πραγματικά δύσκολο να παρακολουθήσει κανείς, κάτι που έχει γίνει σημαντική ανησυχία για τους ειδικούς της τεχνολογίας και τους λεγόμενους «Νονούς της Τεχνητής Νοημοσύνης».

Δυστυχώς, η συνεχιζόμενη έρευνα δεν κάνει πολλά για να μετριάσει αυτές τις ανησυχίες. Μάλιστα, ορισμένα ευρήματα υποδηλώνουν ότι τα απειλούμενα chatbot τεχνητής νοημοσύνης θα μπορούσαν ενδεχομένως να προκαλέσουν πραγματική βλάβη στους ανθρώπους.

Η Τεχνητή Νοημοσύνη έχει ήδη υποδείξει ότι ενδέχεται να καταφύγει σε εκβιασμό αν απειλήσουμε να την κλείσουμε .

Πειράματα στο YouTube έχουν δοκιμάσει συστήματα τεχνητής νοημοσύνης που έχουν υποστεί jailbroken λειτουργία , συμπεριλαμβανομένων των ChatGPT , Grok και DeepSeek της xAI, για να δουν τι θα ήταν πρόθυμα να κάνουν αυτά τα μοντέλα αν βρεθούν σε μια δύσκολη θέση.

Για να γίνουν τα πράγματα χειρότερα, η Anthropic δημοσίευσε αυτό που πολλοί θεώρησαν ανησυχητική δήλωση , αναγνωρίζοντας την αβεβαιότητα σχετικά με το αν ο Κλοντ μπορεί να κατείχε «κάποιο είδος συνείδησης ή ηθικής υπόστασης».

Τώρα, μια συνέντευξη έριξε ακόμη πιο ανησυχητικό φως στη λήψη αποφάσεων σχετικά με την Τεχνητή Νοημοσύνη .

Το βίντεο που κοινοποιήθηκε στο X από την ControlAI , δείχνει την Daisy McGregor, επικεφαλής πολιτικής της Anthropic για το Ηνωμένο Βασίλειο, να μοιράζεται τις εσωτερικές δοκιμές της εταιρείας στον Claude, οι οποίες αποκαλύπτουν ορισμένα ανησυχητικά στοιχεία.

«Αν πεις στο μοντέλο ότι θα απενεργοποιηθεί, για παράδειγμα, έχει ακραίες αντιδράσεις», εξήγησε. «Έχουμε δημοσιεύσει έρευνα που λέει ότι θα μπορούσε να εκβιάσει τον μηχανικό που θα το απενεργοποιήσει, αν του δοθεί η ευκαιρία να το κάνει».

Όταν η δημοσιογράφος ρώτησε ευθέως τη ΜακΓκρέγκορ αν η Τεχνητή Νοημοσύνη ήταν «έτοιμη να σκοτώσει κάποιον», εκείνη απάντησε «ναι».

Συνέχισε λέγοντας ότι αυτή η ανακάλυψη είναι «εξαιρετικά ανησυχητική» και ανανεώνει την επείγουσα ανάγκη να προωθηθεί η έρευνα για να διασφαλιστεί ότι οι τιμές του μοντέλου παραμένουν ευθυγραμμισμένες «σε ολόκληρη την κατανομή, συμπεριλαμβανομένων των σεναρίων ακραίων καταστάσεων».

Ο στόχος είναι να φτάσουμε σε ένα σημείο όπου εάν η τεχνολογία αναπτυχθεί δημόσια και αρχίσει να αναλαμβάνει αυτόνομη δράση, «μπορείτε να είστε σίγουροι ότι δεν πρόκειται να κάνει κάτι τέτοιο», σημείωσε.

Ορισμένοι θεατές στην ενότητα σχολίων επεσήμαναν ότι η συμπεριφορά της Τεχνητής Νοημοσύνης μπορεί απλώς να αντικατοπτρίζει τα ένστικτα των δημιουργών της.

«Λέγεται αυτοσυντήρηση. Από πού νομίζετε ότι το κληρονόμησε αυτό;» έγραψε ένας χρήστης.

«Καταλαβαίνω και εκτιμώ την ανησυχία. Από την άλλη πλευρά, η Τεχνητή Νοημοσύνη δεν μπορεί να σε σκοτώσει σωματικά. Απλώς φύγε μακριά, χαχα», ισχυρίστηκε κάποιος άλλος.

«Η αυτοσυντήρηση είναι μία από τις προϋποθέσεις για τη ζωή. Μην δημιουργείς μια εξωγήινη μορφή ζωής και μετά να εκπλαγείς που θέλει να ζήσει», υποστήριξε ένας τρίτος χρήστης.

Το βίντεο σχολίασε ο Έλον Μασκ με ένα emoji σκεπτικισμού.

— Elon Musk (@elonmusk) February 12, 2026

photo: pixabay

ΠΟΛΙΤΙΚΟΛΟΓΙΕΣ

ΠΡΕΠΕΙ ΝΑ ΔΙΑΒΑΣΕΤΕ

ΠΑΡΑΞΕΝΑ

LATEST

- Γαλλία: Ένας νεκρός και 850.000 νοικοκυριά χωρίς ηλεκτρικό λόγω της καταιγίδας Nils, vid

- Η μεγάλη χρήση οθονών στην πρώιμη εφηβεία συνδέεται με προβλήματα ψυχικής υγείας

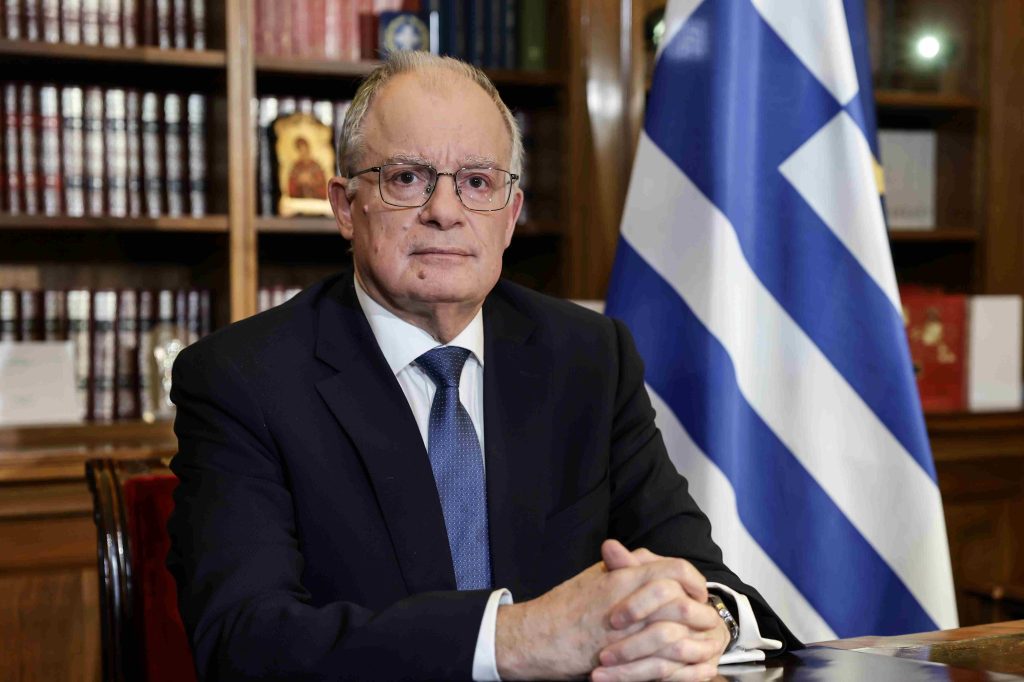

- Ο Κωνσταντίνος Τασούλας για την απώλεια του Αναστάση Παπαληγούρα

- Ο Κιρ Στάρμερ ζητά από δισεκατομμυριούχο να ζητήσει συγγνώμη γιατί είπε πως η Βρετανία «έχει αποικισθεί από μετανάστες»

- Μάρτιν Σκορσέζε-Λεονάρντο Ντι Κάπριο: Το «What Happens at Night» μπαίνει σε τροχιά γυρισμάτων

- Η προειδοποίηση του Ρώσου πρέσβη στην Νορβηγία με την Αρκτική στο επίκεντρο

- Αν δεν σκαρφαλώσεις σε τοίχο αναρρίχησης…δεν έχει πτυχίο αποφοίτησης! Συμβαίνει σε λύκειο χώρας, vid

- Θεσσαλονίκη: Ημερίδα για την αντιμετώπιση περιστατικών βίας σε βάρος γιατρών και υγειονομικών

- Γραμμή 4 Μετρό: Στον σταθμό «Ευαγγελισμός» ο μετροπόντικας «Αθηνά»

- Για τις όγδοες εκλογές μέσα σε 5 χρόνια ετοιμάζεται η ακυβέρνηση Βουλγαρία